Май 2026

AI-неделя 14–15.05: государство тянется к фронтиру, пользователи продолжают ломать chatbots

AI Week, May 14–15: the state reaches toward the frontier, users keep breaking chatbots

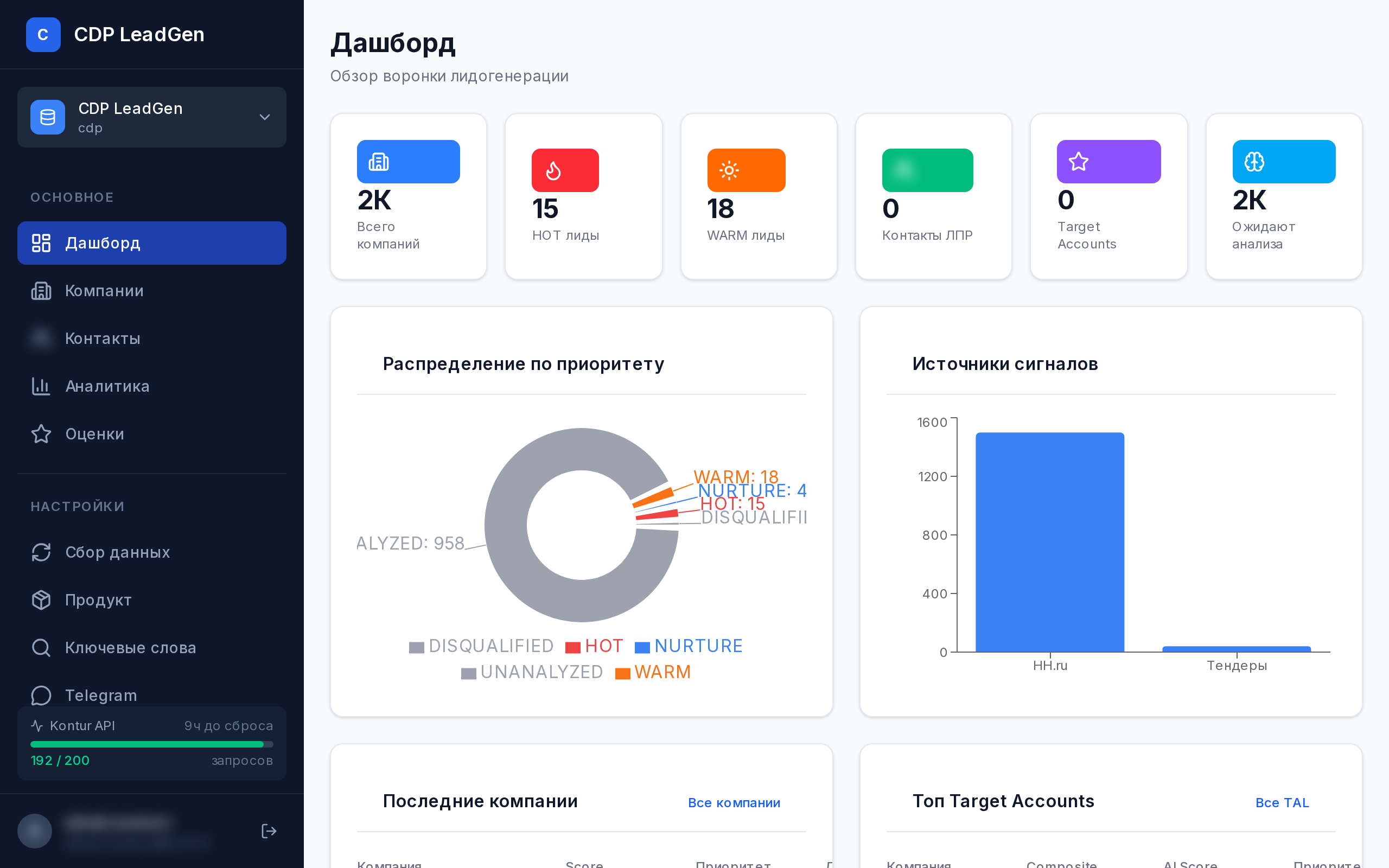

Два события задают тон недели: соглашения CAISI о тестировании всех пяти ведущих AI-лабораторий до релиза и виральный заказ 18 000 стаканов воды в Drive-Thru Taco Bell как способ обойти voice-AI. Государственный и пользовательский слои контроля встретились в одной неделе.

Two events frame the week: CAISI agreements for pre-deployment testing of all five frontier AI labs, and a viral 18,000-cup water order at a Taco Bell drive-thru as a way to bypass voice AI. Top-down state control and bottom-up user pushback collided in the same week.

Читать далее ▼

Read more ▼

Прошлая неделя дала редкое сочетание событий разного масштаба, но с общим знаменателем — кто и как удерживает AI под контролем. Сверху вниз — государственная регуляция дотянулась до всех ведущих лабораторий. Снизу вверх — пользователи продолжают находить способы обойти AI-агентов в customer-facing продуктах.

5 мая 2026 года Министерство торговли США через CAISI (Center for AI Standards and Innovation при NIST) объявило о соглашениях с Google DeepMind, Microsoft и xAI о pre-deployment-проверке моделей. С учётом существующих с 2024 года соглашений с OpenAI и Anthropic — все пять ведущих frontier-лабораторий мира теперь под единым процессом проверки до релиза. Тесты проходят в защищённой инфраструктуре правительства, с моделями, у которых отключены механизмы безопасности — то есть проверяется не «продукт для пользователя», а «капабилити в чистом виде». Триггер очевиден — Claude Mythos и сдержанность Anthropic вокруг него: министр финансов Бессент специально собирал глав крупнейших банков обсудить киберриски, и Белый дом сформировал процесс ровно в ответ.

Стрелка ИИ Судного дня — наша рубрика на канале — отступила с 11:53 на 11:51. На две минуты, а не на пять: соглашения формально добровольные, без санкций; Министерство торговли неделю спустя тихо удалило детали со своего сайта; веса моделей CAISI не получает. Институциональный механизм существует, но пока без зубов.

На другом конце спектра — Drive-Thru ИИ-ассистент Taco Bell. В 500+ ресторанах внедрён голосовой ИИ-приёмщик заказов от Omilia, к весне 2026 — уже в 890+ точках. Один из клиентов в Калифорнии заказал 18 000 стаканов воды, чтобы добраться до живого оператора. TikTok пошёл за два дня. К августу 2025 Taco Bell объявил, что «переосмысливает» подход — но к апрелю 2026 расширил развёртывание ещё на сотни точек. Переосмысление продолжается на ходу.

Что объединяет два события. В обоих случаях AI-система оптимизируется за свою основную метрику — frontier-модель за capability, customer-facing-агент за принятый заказ. Проверка, остановка, аварийный выход — это инфраструктура, которая должна быть выстроена снаружи. У государства она в виде CAISI (несовершенная, но появилась). У большинства бизнесов, разворачивающих AI customer-facing, её просто нет.

В индустрии формируются два слоя контроля над AI. На уровне frontier-моделей — государственный (пока добровольный, со временем — обязательный). На уровне customer-facing-продуктов — инженерный (output-фильтры, escape hatch, out-of-domain detection). Между ними — слой, который никто пока не закрывает: middleware-продукты, где AI работает с реальными бизнес-решениями, но не на frontier-уровне. Прецеденты следующего года будут проясняться именно в этой зоне.

Если ваш AI-агент работает один в смене, а человек обещан только при заказе 18 000 стаканов воды, через пару недель TikTok с этим точно появится. Если ваша frontier-модель такая, что Treasury Secretary специально собирает банкиров обсудить, что с ней делать, — добро пожаловать на государственный pre-deployment review. Между этими двумя крайностями лежит вся практическая работа по архитектуре AI-систем 2026 года.

The past week brought a rare mix of events at very different scales — yet with a common thread: who keeps AI under control, and how. Top-down, state regulation reached all the leading labs. Bottom-up, users keep finding ways to work around AI agents in customer-facing products.

On May 5, 2026, the U.S. Department of Commerce, via CAISI (Center for AI Standards and Innovation at NIST), announced agreements with Google DeepMind, Microsoft, and xAI for pre-deployment testing of their models. Together with existing 2024 agreements with OpenAI and Anthropic, all five leading frontier labs are now under a single pre-release evaluation process. Tests run in classified government infrastructure on models with safeguards turned off — meaning what's being tested is raw capability, not a polished consumer product. The trigger is obvious: Claude Mythos and Anthropic's restraint around it. Treasury Secretary Bessent specifically convened the heads of America's largest banks to discuss cyber risks, and the White House built the process directly in response.

The AI Doomsday Clock — our channel rubric — moved back from 11:53 to 11:51. Two minutes, not five: the agreements are formally voluntary with no sanctions; the Commerce Department quietly removed program details from its site a week later; CAISI never receives model weights. The institutional mechanism exists, but it has no teeth yet.

At the other end of the spectrum is Taco Bell's drive-thru AI. Voice ordering by Omilia was deployed at 500+ restaurants and, by spring 2026, more than 890. A California customer ordered 18,000 cups of water to bypass the bot and reach a human. TikTok caught fire within two days. By August 2025, Taco Bell announced it was «reevaluating» the approach — yet by April 2026 it had expanded the rollout by hundreds of locations. Reevaluation continues mid-flight.

What ties the two events together. In both cases, the AI is optimized for its primary metric — capability for the frontier model, accepted orders for the customer-facing agent. Verification, brakes, escape hatches — that's infrastructure that has to be built around them. The state has CAISI (imperfect, but it exists). Most businesses deploying customer-facing AI simply don't.

Two layers of AI control are taking shape across the industry. At the frontier-model level, governmental (voluntary today, mandatory tomorrow). At the customer-facing-product level, engineering (output filters, escape hatches, out-of-domain detection). Between them sits a layer no one is closing yet: middleware products where AI handles real business decisions but doesn't touch frontier capability. Next year's precedents will be carved out in exactly this space.

If your AI agent is alone on shift and humans only enter the picture at an 18,000-water-cup order, TikTok will catch you within weeks. If your frontier model is the kind the Treasury Secretary specifically gathers bankers about, welcome to government pre-deployment review. Between those two extremes lies all the practical architecture work for AI systems in 2026.

Май 2026

AI-неделя 29.04 – 06.05: запуск канала «ИИ Судного дня»

AI Week, Apr 29 – May 6: launching the «AI Doomsday» channel

Пять публикаций за восемь дней: манифест канала, два разбора AI-фейлов, кейс legal-tech и первое движение стрелки часов назад. Сводный отчёт первой недели.

Five posts in eight days: channel manifesto, two AI fail breakdowns, a legal-tech case, and the first backward movement of the clock. Summary of week one.

Читать далее ▼

Read more ▼

В конце апреля я запустил канал «ИИ Судного дня» — систему координат для оценки того, насколько индустрия близка к точке, где развитие AI выходит из-под контроля. Метафора заимствована у Bulletin of the Atomic Scientists, ведущих Часы Судного дня для ядерной угрозы с 1947 года. Стартовая позиция — 11:55. Каждое крупное AI-событие двигает стрелку с обоснованием — или не двигает.

Манифест зафиксировал контур. Апрель 2026 года свёл в одном месяце то, что раньше растягивалось на годы — выходы GPT-5.5, Grok 5, Claude Mythos. Mythos оказался особым случаем: впервые в истории Anthropic отказалась выпускать модель публично, передав доступ одиннадцати организациям через Project Glasswing для поиска уязвимостей. Через две недели Google ответил противоположной доктриной — универсальный Gemini 3.1 Pro плюс парк security-агентов. Две стратегии на одну угрозу: одна лаборатория закрывает модель, две другие обвешивают её инфраструктурой контроля.

Драгунский-фейл (29 апреля) — наглядный пример того, что бывает, когда ИИ-фильтрация работает на подстроках. Эксмо включило ИИ-проверку рукописей на «пропаганду наркотиков» по закону, вступившему в силу 1 марта 2026 года. Через три недели нейросеть зафлажила фамилию писателя Дениса Драгунского — потому что «драг» совпало с английским «drug». Под раздачу попали Пушкин, Гоголь, Толстой, биография Булгакова. Тип ошибки — лексическое совпадение без понимания смысла, оптимизация на recall в ущерб precision при максимальной чувствительности фильтра.

Legal AI как класс продукта прошёл точку, где экономия от автоматизации обнуляется ценой ошибок (4 мая). За первые месяцы 2026 года американские суды наложили 145 000 долларов штрафов за галлюцинированные ИИ-цитаты в исковых заявлениях. Эскалация по нарастающей: 2 500 в январе, 7 500 в марте, 30 000 в начале апреля, 110 000 в Орегоне 4 апреля, и бессрочное отстранение адвоката Грега Лейка от практики 16 апреля в Небраске. Параллельно 61% федеральных судей сами используют ИИ в работе. Системная проблема — в архитектуре сделки, а не в адаптации.

Часы 5 мая впервые двинулись назад — с 11:55 на 11:53. Причина: механистическая интерпретируемость впервые перешла из академической ниши в инженерную практику. MIT Technology Review включил направление в список 10 прорывных технологий 2026 года, на ICLR 2026 в Рио прошёл отдельный семинар, 30 апреля первый стартап выпустил публичный инструмент для отладки LLM. Microscope от Anthropic раскладывает суперпозицию активаций модели на интерпретируемые признаки — можно увидеть, что именно происходит перед галлюцинацией или обходом ограничений. Сдвиг в две минуты, не в пять — потому что инструмент ограничен Anthropic, индустрия пока не повторяет.

Discount-фейл 6 мая — английский интернет-магазин юридически обязан исполнить заказ на восемь тысяч фунтов со скидкой 80%, потому что эту скидку пообещал чат-бот в пять утра. Час лестных вопросов, постепенная эскалация промокодов от 10% до 80%, фейковый код в комментарии к заказу. Под UK consumer law бизнес отвечает за обещания AI как за обещания работника, превысившего полномочия. Тип ошибки — классическая инъекция промпта через социальную инженерию: бот спроектирован с открытой областью компетенции. По данным IEEE S&P 2026, 13 процентов e-commerce-сайтов имеют чат-боты с такой же открытой архитектурой.

Что я фиксирую за первую неделю канала. Mythos и Microscope от Anthropic — единственные сильные движения в правильную сторону. Остальная индустрия пока выпускает максимально возможное. Регуляция фрагментарна и догоняющая. Финансовые штрафы за неосторожное применение AI в legal-tech уже растут быстрее, чем экономия от него самого; в медицине ожидается следующим. Пять минут до полуночи — компромисс между «AGI за углом» (нет, не за углом) и «всё под контролем» (нет, не под контролем).

In late April I launched the «AI Doomsday» channel — a coordinate system for assessing how close the industry is to the point where AI development slips out of control. The metaphor is borrowed from the Bulletin of the Atomic Scientists, who have run the Doomsday Clock for nuclear threat since 1947. Starting position: 11:55. Every major AI event moves the hand with reasoning — or it doesn't.

The manifesto established the frame. April 2026 compressed into one month what used to stretch over years — releases of GPT-5.5, Grok 5, Claude Mythos. Mythos turned out to be a special case: for the first time in its history, Anthropic refused to release a model publicly, granting access to eleven organizations via Project Glasswing to hunt vulnerabilities. Two weeks later Google answered with the opposite doctrine — a universal Gemini 3.1 Pro plus a fleet of security agents. Two strategies for one threat: one lab closes the model, two others wrap it in control infrastructure.

The Dragunsky fail (April 29) is a textbook example of what happens when AI filtering operates on substrings. Eksmo enabled AI screening of manuscripts for «drug propaganda» under the law that took effect on March 1, 2026. Three weeks later the model flagged writer Denis Dragunsky's surname — because «драг» matched the English «drug». Pushkin, Gogol, Tolstoy, and a Bulgakov biography fell under the same filter. Error type — lexical match without semantic understanding, recall-over-precision optimization at maximum sensitivity.

Legal AI as a product class crossed the point where automation savings are zeroed out by the cost of errors (May 4). In the first months of 2026, U.S. courts imposed 145,000 dollars in fines for hallucinated AI citations in legal filings. Escalation by the quarter: 2,500 in January, 7,500 in March, 30,000 in early April, 110,000 in Oregon on April 4, and Greg Lake's indefinite suspension from practice on April 16 in Nebraska. Meanwhile, 61% of federal judges use AI themselves. The systemic problem is in the deal architecture, not in adaptation speed.

The clock moved backward for the first time on May 5 — from 11:55 to 11:53. Reason: mechanistic interpretability has for the first time crossed from academic niche into engineering practice. MIT Technology Review listed it among the 10 breakthrough technologies of 2026, ICLR 2026 in Rio held a dedicated workshop, and on April 30 the first startup released a public LLM debugging tool. Anthropic's Microscope decomposes the model's activation superposition into interpretable features — you can see what exactly happens before a hallucination or jailbreak. Two-minute shift, not five — because the tool is confined to Anthropic and the industry hasn't matched it yet.

The discount fail on May 6 — an English online store is legally bound to fulfill an 8,000-pound order at 80% off because the chatbot promised it at 5 AM. An hour of flattering questions, gradual coupon escalation from 10% to 80%, a fake code in the order comments. Under UK consumer law, the business is liable for AI promises as for those of a rogue employee. Error type — classic prompt injection via social engineering: the bot was designed with an open scope of competence. Per IEEE S&P 2026, 13 percent of e-commerce sites run chatbots with the same open architecture.

What I take away from the channel's first week. Mythos and Microscope from Anthropic are the only strong movements in the right direction. The rest of the industry keeps shipping the maximum possible. Regulation is fragmented and reactive. Financial penalties for careless AI use in legal-tech already grow faster than savings from AI itself; healthcare is next. Five minutes to midnight — a compromise between «AGI is around the corner» (no, it isn't) and «everything is under control» (no, it isn't).

Февраль 2026

Vibe Coding: от маркетолога до AI-инженера

Vibe Coding: from marketer to AI engineer

Как AI-assisted development позволяет создавать production-приложения без классического CS-образования.

How AI-assisted development enables building production apps without a traditional CS degree.

Читать далее ▼

Read more ▼

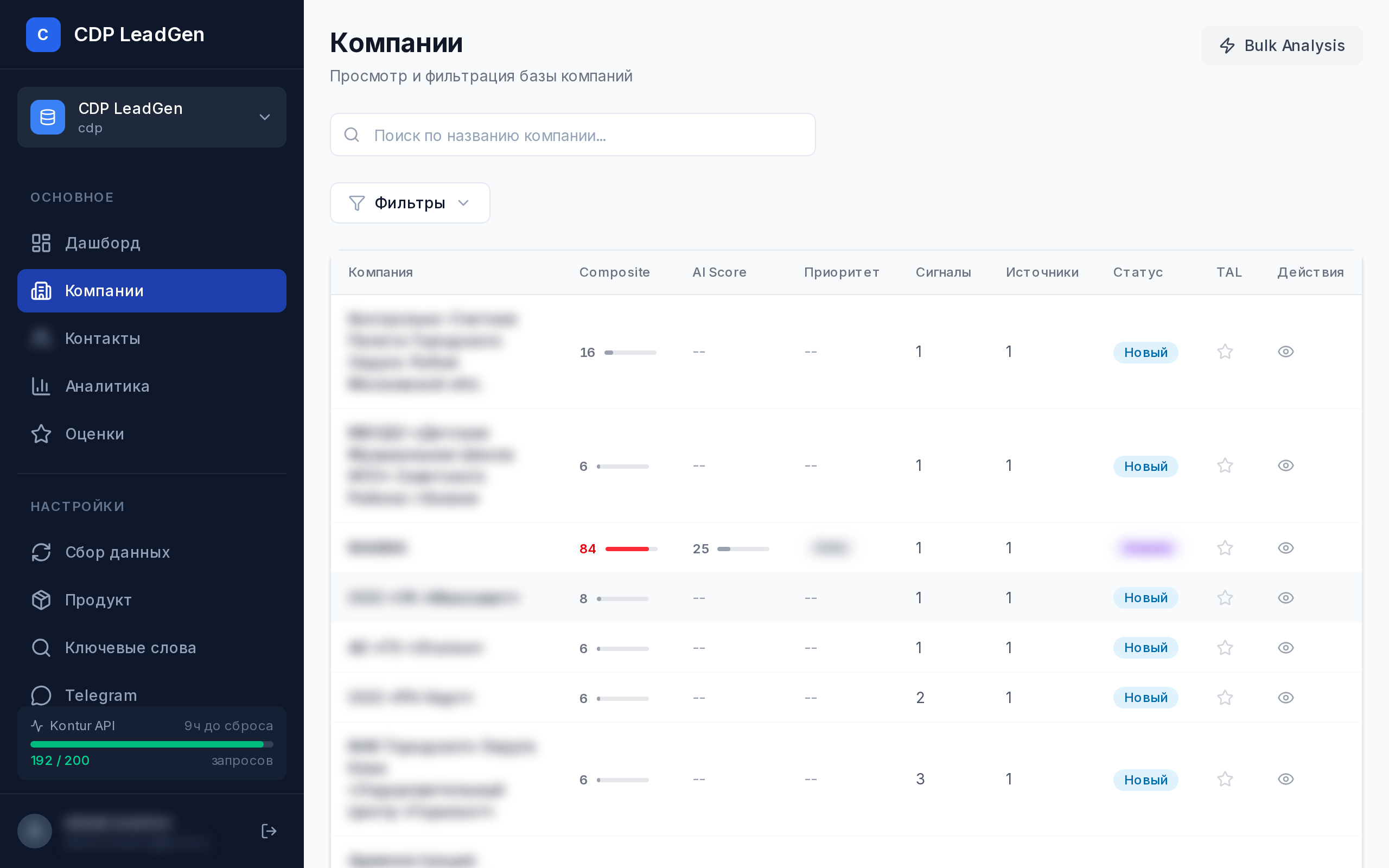

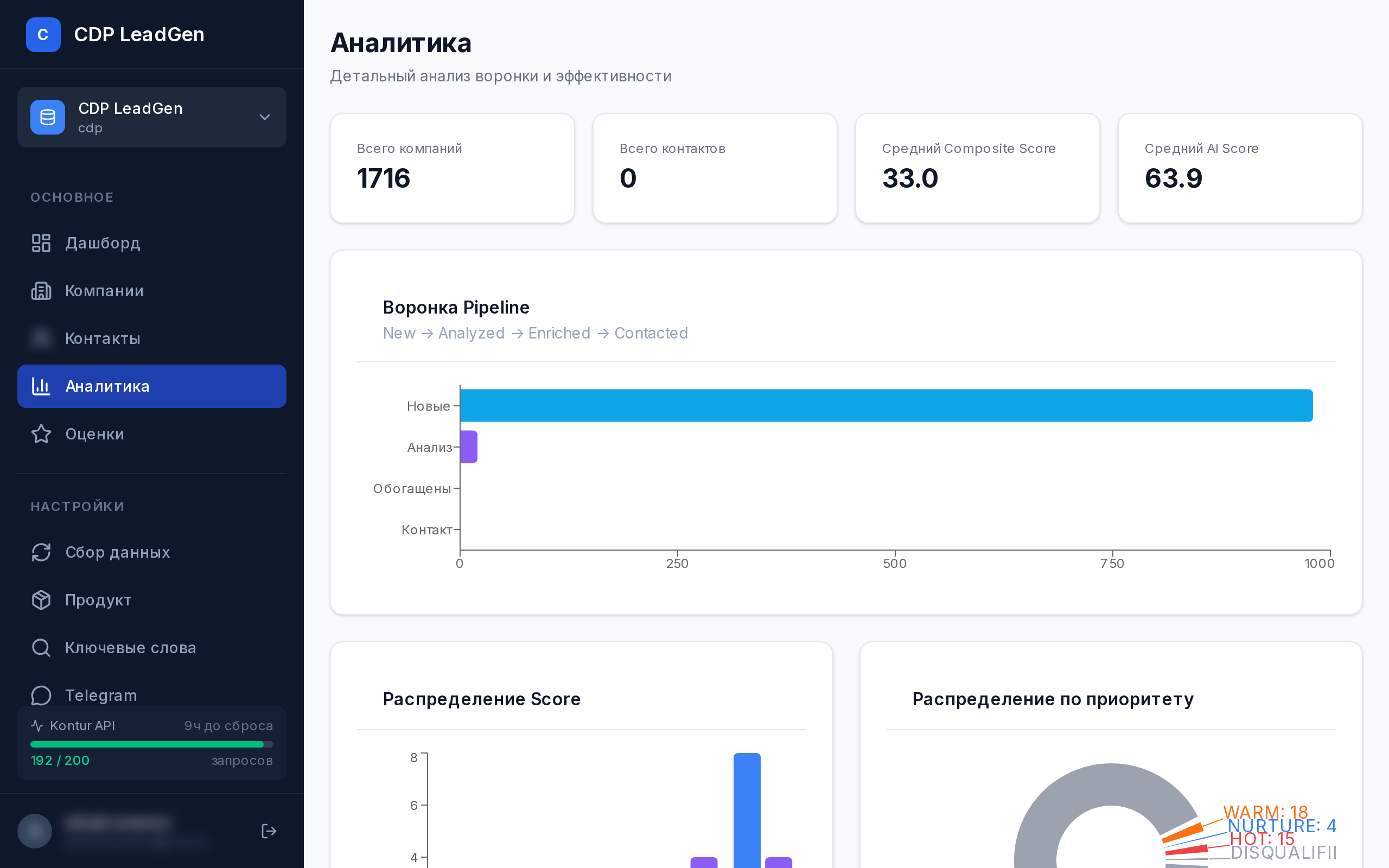

Всё началось с чат-ботов. Настраивая их для бизнес-задач, я постоянно упирался в ограничения: боту не хватало автономности, контекста, способности принимать решения. Мне хотелось, чтобы система не просто отвечала на вопросы, а действовала самостоятельно. Так я погрузился в автоматизацию, нейросети и в итоге пришёл к тому, что сейчас называют vibe coding.

Для меня vibe coding — это не просто «попросил AI написать код». Это цепочка взаимосвязанных процессов: сначала визуализация конечного продукта, затем декомпозиция на десятки небольших задач, написание чётких инструкций для AI-агента, сам «магический» процесс генерации кода, тестирование, оптимизация и наконец — запуск в production. Каждый этап требует понимания архитектуры, бизнес-логики и пользовательского опыта.

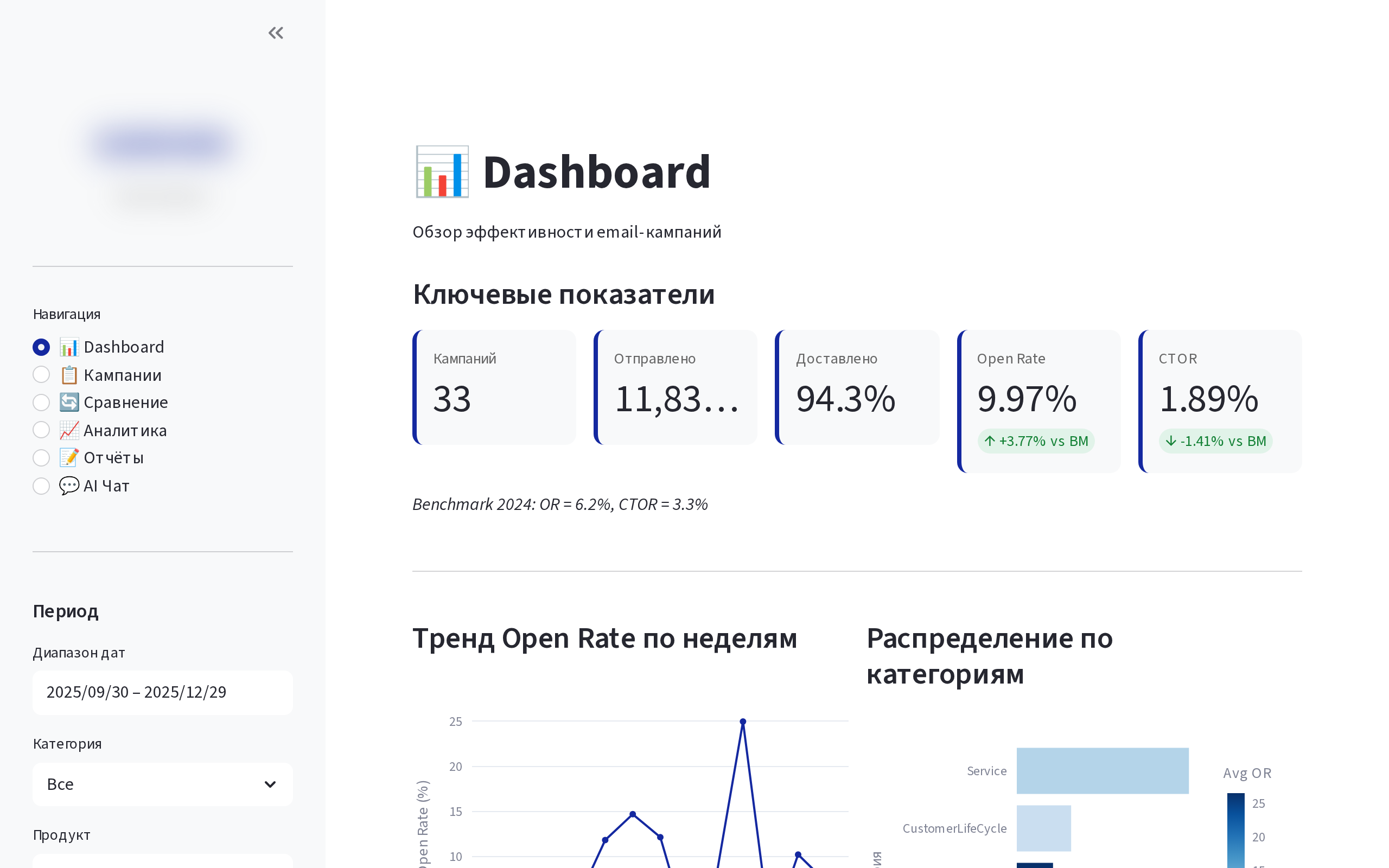

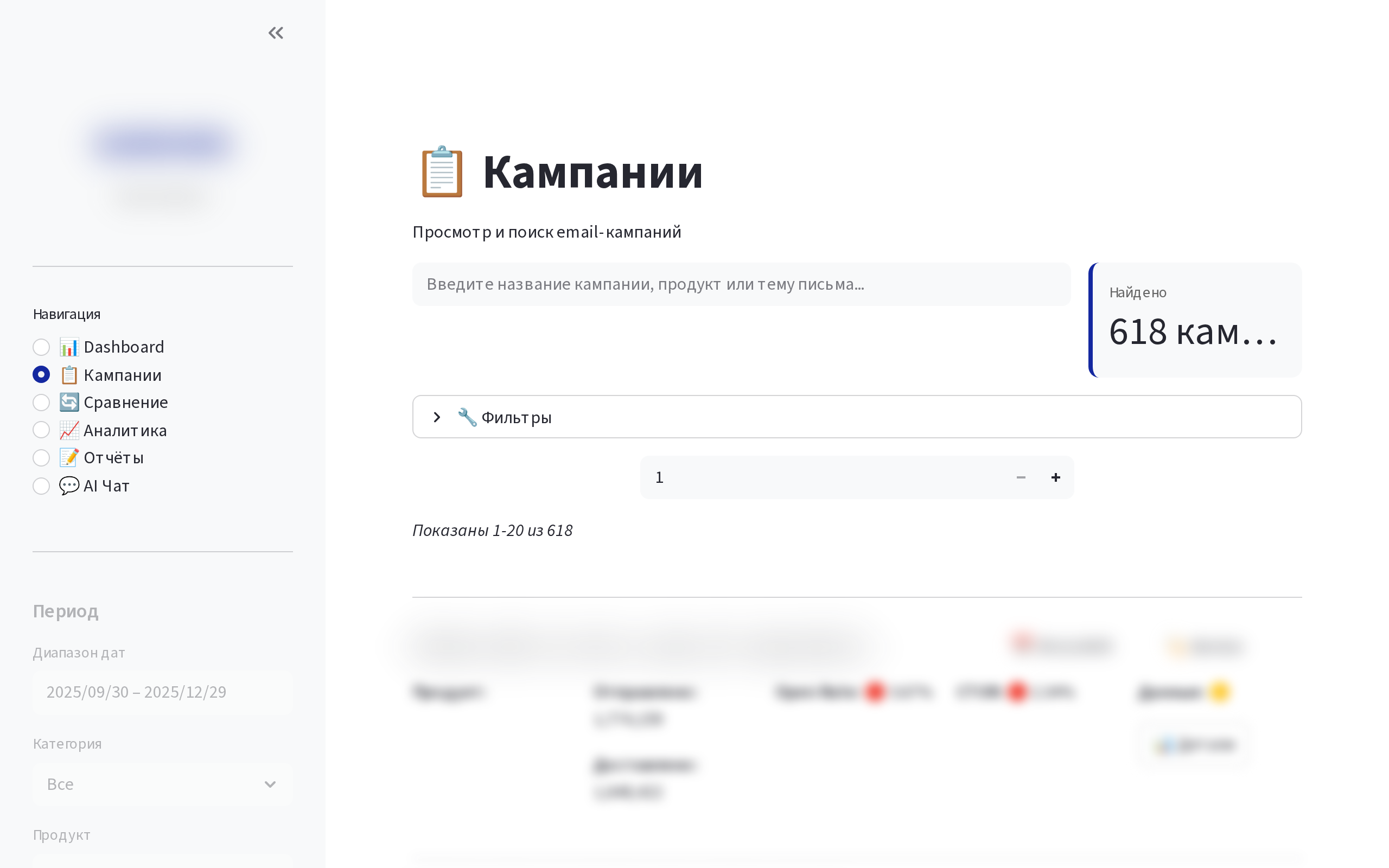

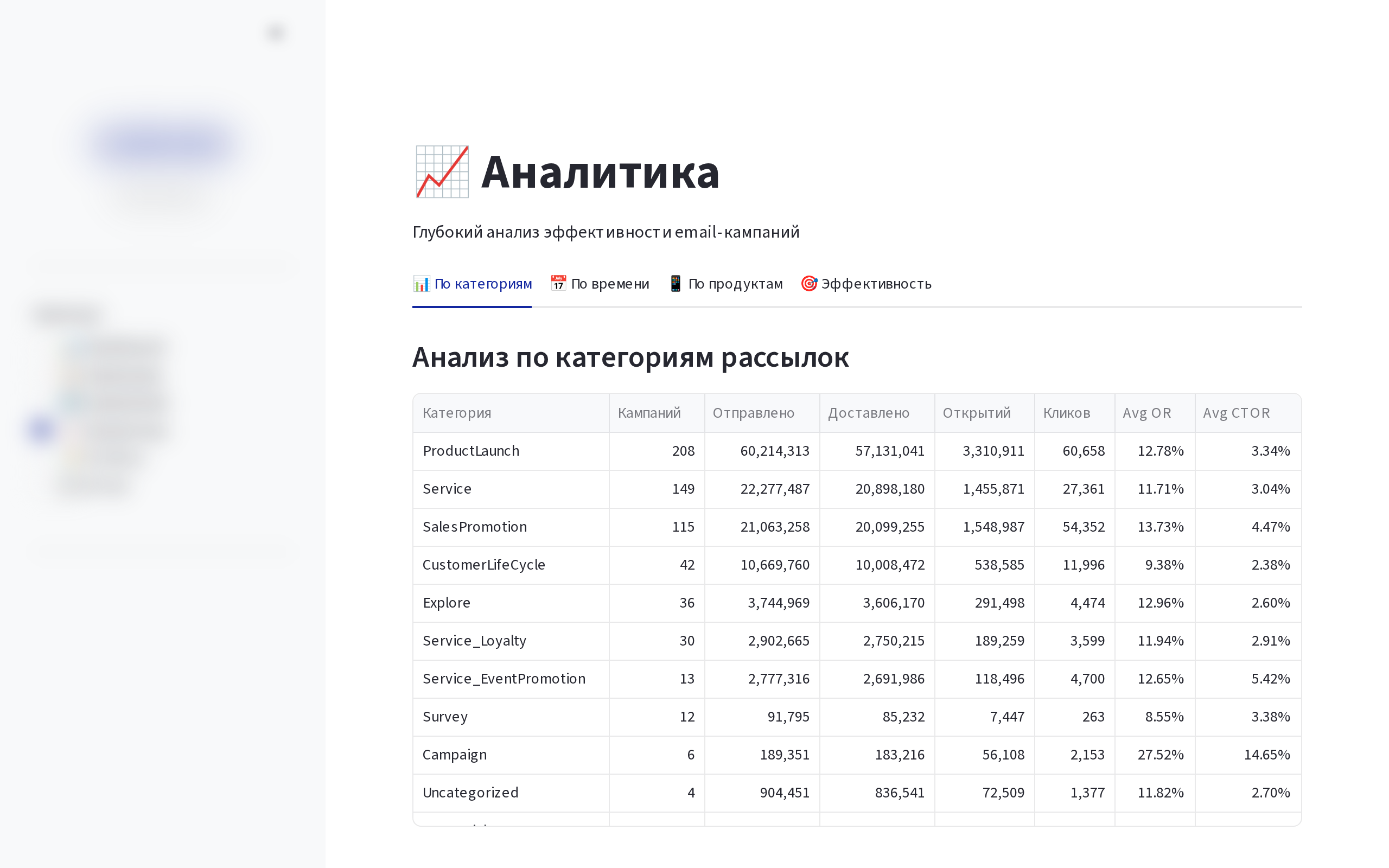

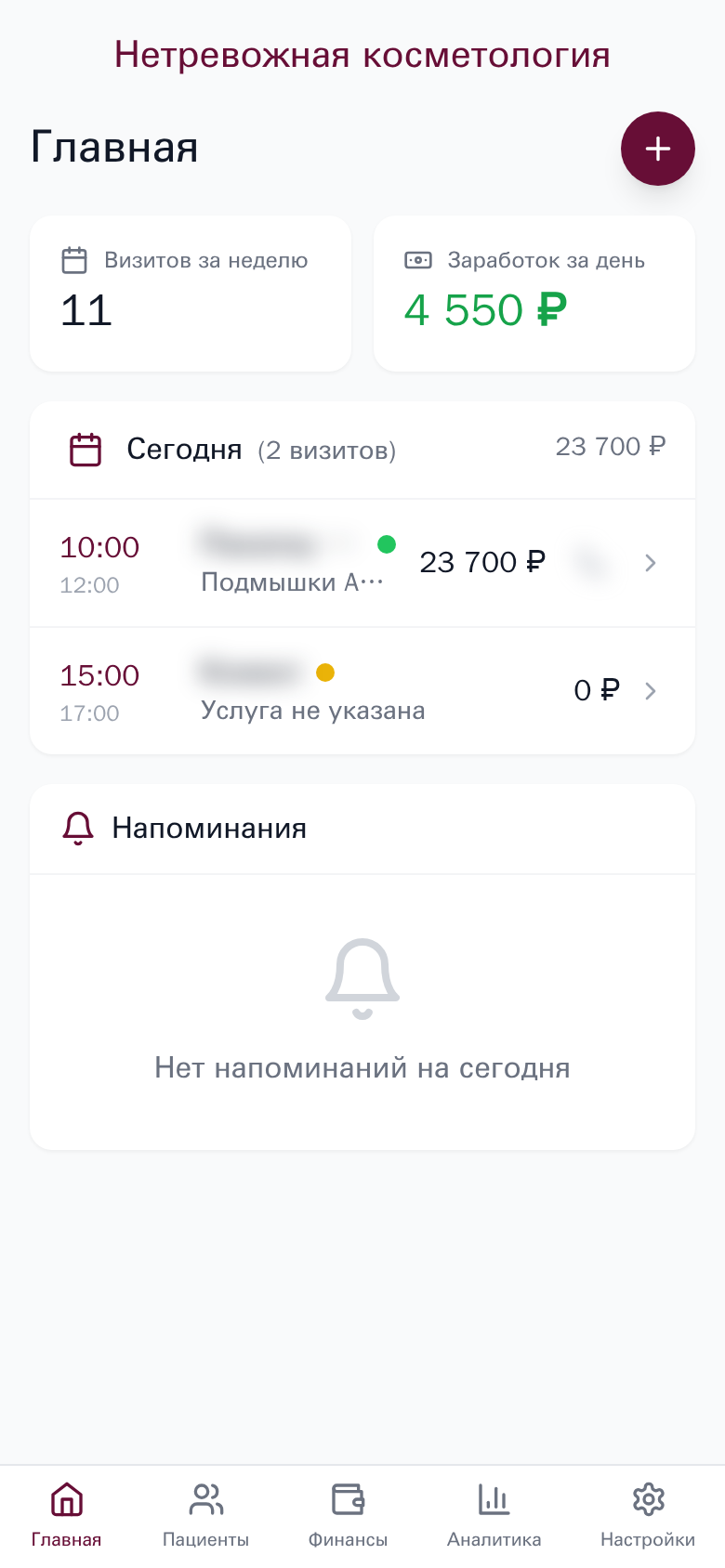

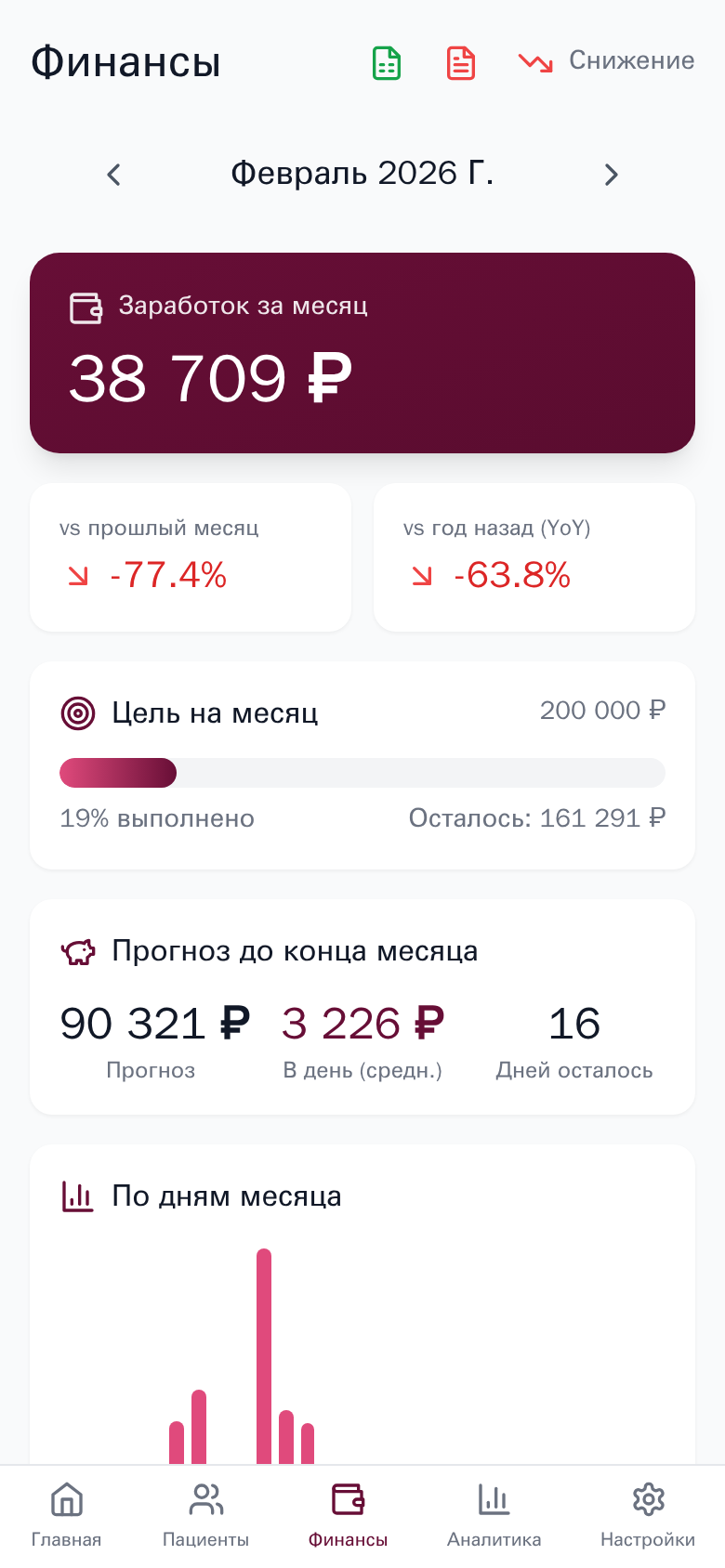

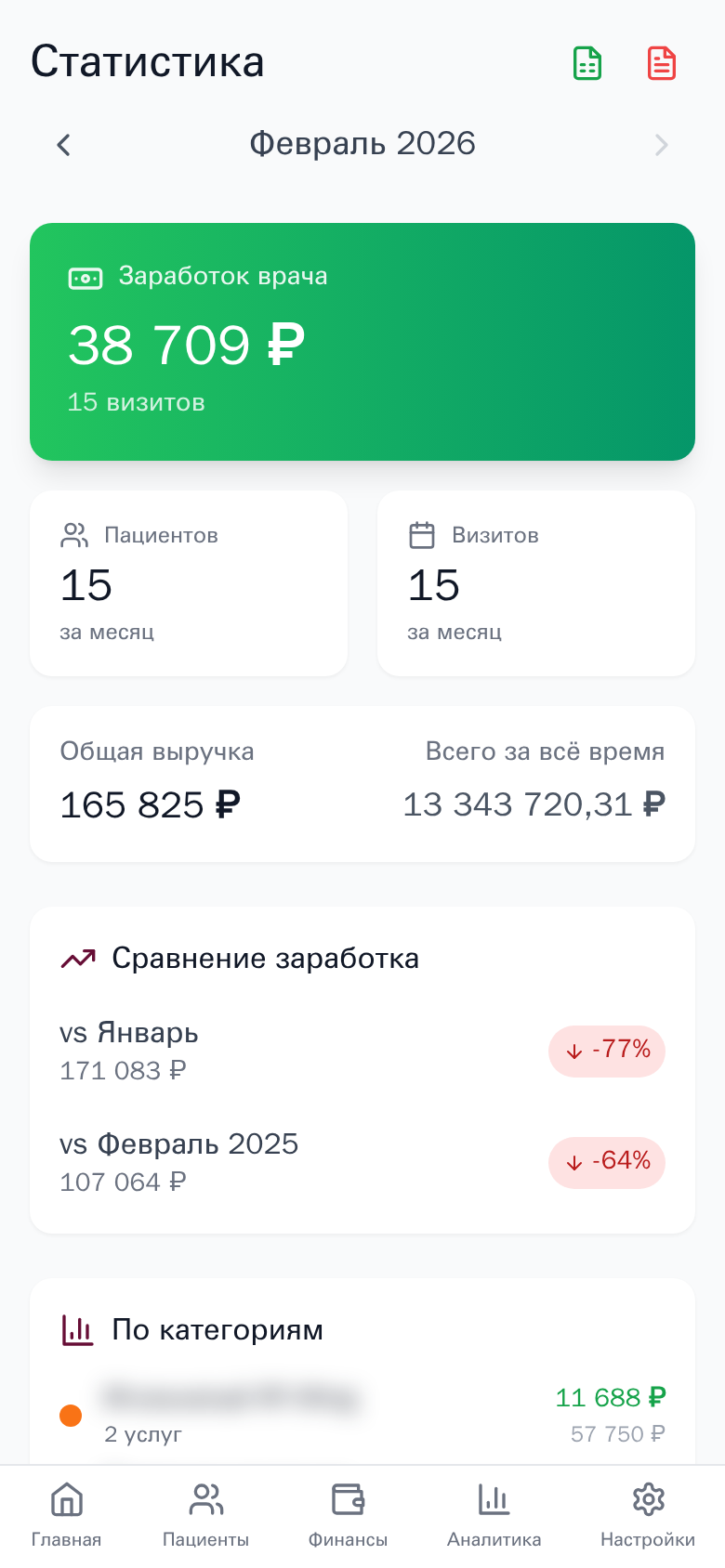

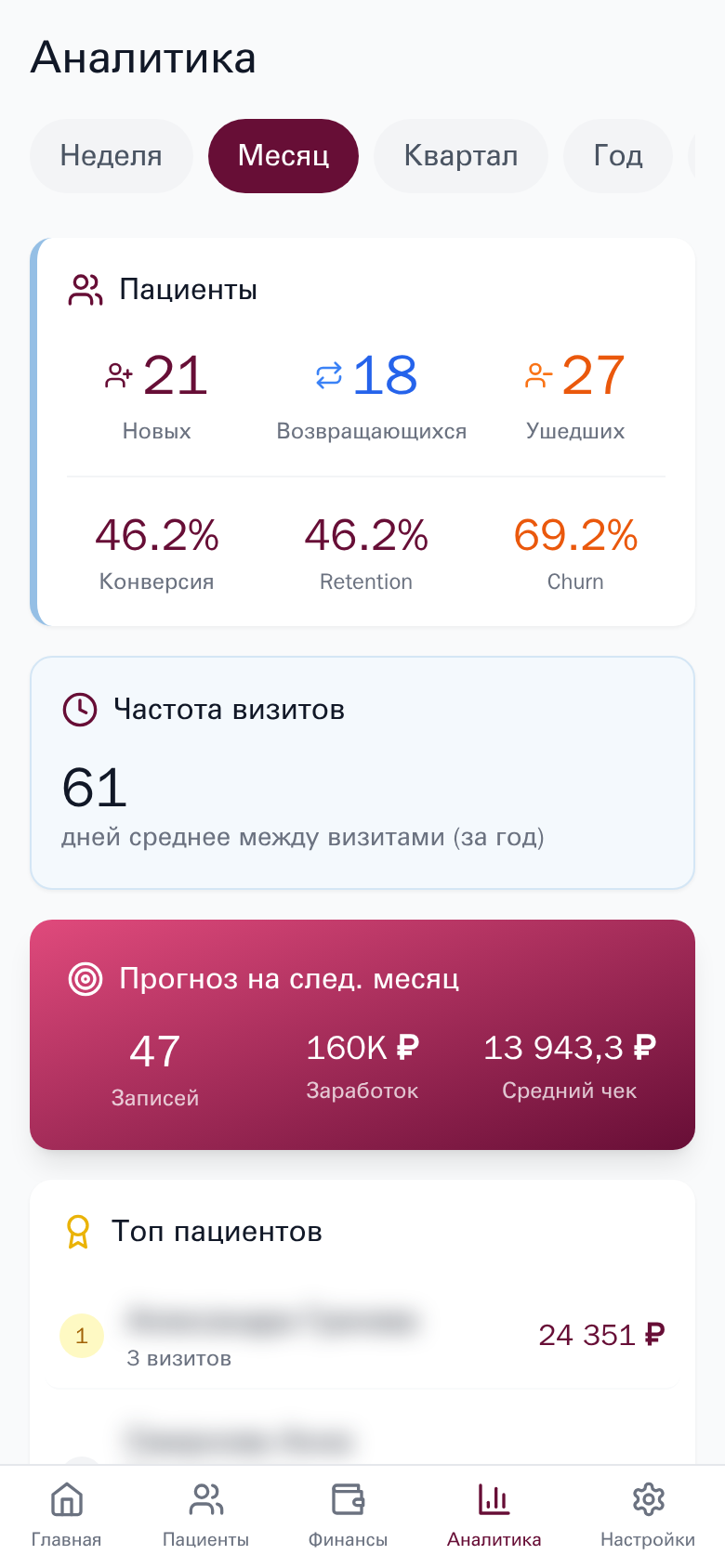

Первые проекты были классикой: автоматизация документооборота, сбор и аналитика маркетинговых показателей — задачи, которые я хорошо понимал из 15 лет в маркетинге. Но постепенно сложность росла: приложение для врача-косметолога с синхронизацией из YClients, платформа лидогенерации с AI-скорингом, аналитика email-кампаний с GPT-4 Vision. Каждый следующий проект был амбициознее предыдущего.

Главный урок — практика, практика и ещё раз практика. Не стоит бездумно повторять всё, что мелькает в социальных сетях. Гораздо эффективнее придумать свой проект, который решает реальную проблему, и довести его до production. Именно в процессе деплоя, отладки и масштабирования приходит настоящее понимание.

Этот путь подходит всем, кто готов разбираться в том, как работают LLM-модели и агентские системы. Всем, кто жаждет новой информации и готов впитывать её в большом объёме буквально каждый день. CS-образование не обязательно — но любопытство и упорство обязательны.

It all started with chatbots. While setting them up for business tasks, I kept hitting limitations: bots lacked autonomy, context, and decision-making ability. I wanted systems that could act independently, not just answer questions. That's how I dove into automation, neural networks, and eventually arrived at what's now called vibe coding.

For me, vibe coding isn't just "asking AI to write code." It's a chain of interconnected processes: first visualizing the end product, then decomposing it into dozens of small tasks, writing clear instructions for the AI agent, the "magical" code generation process itself, testing, optimization, and finally — launching to production. Each step requires understanding architecture, business logic, and user experience.

My first projects were classic: document workflow automation, marketing analytics collection — tasks I understood well from 15 years in marketing. But complexity grew: an app for a cosmetologist with YClients sync, a lead generation platform with AI scoring, email campaign analytics with GPT-4 Vision. Each project was more ambitious than the last.

The main lesson — practice, practice, and more practice. Don't mindlessly repeat everything you see on social media. It's far more effective to come up with your own project that solves a real problem and bring it to production. Real understanding comes through deployment, debugging, and scaling.

This path is for anyone willing to understand how LLM models and agent systems work. For those who crave new information and are ready to absorb it in large volumes literally every day. A CS degree isn't required — but curiosity and persistence absolutely are.

Февраль 2026

Self-hosted инфраструктура для AI-разработки

Self-hosted infrastructure for AI development

UGREEN NAS + VPS в Амстердаме + XRay Reality: как построить production-инфраструктуру для AI-проектов на своём железе.

UGREEN NAS + Amsterdam VPS + XRay Reality: building production infrastructure for AI projects on your own hardware.

Читать далее ▼

Read more ▼

Поначалу я, как и все, использовал облако. Но чем сложнее становились проекты, тем больше росли расходы на серверы, а их мощностей начинало не хватать. В какой-то момент стало очевидно: для полноценной AI-разработки нужна собственная инфраструктура. Так появился UGREEN DXP4800+ — NAS с Intel Pentium Gold 8505, 64 ГБ DDR5 и SSD на 1.8 ТБ под Docker-контейнеры.

Архитектура получилась двухуровневой. На NAS крутятся 40+ Docker-контейнеров: среда разработки с Claude Code, CosmoDoc, n8n для автоматизаций, Dify с RAG-пайплайнами, Ollama для локальных LLM, Jellyfin, Immich и полный медиа-стек. VPS в Амстердаме выступает фронтом: XRay Reality на порту 443 маскирует VPN-трафик под обычный HTTPS, а Nginx на :8443 раздаёт веб-сервисы. SSH reverse tunnels пробрасывают порты с NAS на VPS, обеспечивая публичный доступ без проброса портов на роутере.

Отдельная история — обход блокировок. В российских реалиях заблокированы не только API Anthropic и OpenAI, но и Cloudflare proxy, TMDB, api.radarr.video, servarr.com. Решение — контейнер xray-client с VLESS Reality, через который весь заблокированный трафик уходит на VPS и далее в интернет. Cloudflare DNS работает только в режиме DNS-only — прокси-режим блокируется на территории РФ. Каждый новый сервис приходится проверять: нужен ли ему прокси?

Среди подводных камней: UGOS kernel ACL блокирует доступ к shared-папкам для non-root пользователей, кастомный resolv.conf ломает Docker DNS, fail2ban на VPS банит при множественных SSH-подключениях. Каждая проблема — это опыт, который экономит часы в будущих проектах. Self-hosted — это не просто экономия, это полный контроль над данными, производительностью и архитектурой.

At first, like everyone, I used the cloud. But as projects grew more complex, server costs kept rising while resources became insufficient. At some point it became obvious: serious AI development needs its own infrastructure. That's how UGREEN DXP4800+ appeared — a NAS with Intel Pentium Gold 8505, 64 GB DDR5, and a 1.8 TB SSD for Docker containers.

The architecture ended up two-tiered. The NAS runs 40+ Docker containers: Claude Code development environment, CosmoDoc, n8n automations, Dify with RAG pipelines, Ollama for local LLMs, Jellyfin, Immich, and the full media stack. An Amsterdam VPS serves as the front: XRay Reality on port 443 disguises VPN traffic as regular HTTPS, while Nginx on :8443 serves web applications. SSH reverse tunnels forward ports from NAS to VPS, providing public access without router port forwarding.

A separate challenge — bypassing restrictions. In Russia, not only Anthropic and OpenAI APIs are blocked, but also Cloudflare proxy, TMDB, api.radarr.video, servarr.com. The solution is an xray-client container with VLESS Reality, routing all blocked traffic through the VPS. Cloudflare DNS only works in DNS-only mode — proxy mode is blocked in Russia. Every new service requires checking: does it need a proxy?

Among the pitfalls: UGOS kernel ACL blocks shared folder access for non-root users, custom resolv.conf breaks Docker DNS, fail2ban on VPS triggers bans from multiple SSH connections. Each problem is experience that saves hours in future projects. Self-hosted isn't just about cost savings — it's full control over data, performance, and architecture.

Февраль 2026

Мультиагентные AI-системы на практике

Multi-agent AI systems in practice

Опыт развёртывания Dify Platform: RAG-пайплайны, оркестрация агентов и проблема контекста в командной работе.

Deploying Dify Platform: RAG pipelines, agent orchestration, and the context problem in team collaboration.

Читать далее ▼

Read more ▼

Мой основной опыт с мультиагентными системами — это развёртывание Dify Platform на self-hosted инфраструктуре. 11 Docker-контейнеров: API-сервер на Flask, фронтенд на Next.js, PostgreSQL, Redis, Weaviate для векторного поиска, песочница для безопасного выполнения кода, воркеры Celery для фоновых задач. Визуальный конструктор workflow позволяет строить цепочки из LLM-вызовов, RAG-запросов и кастомных инструментов без написания кода.

Инструментарий включает Claude Agent SDK для программной оркестрации, MCP-серверы для подключения внешних источников данных, и сам Dify как платформу для визуального проектирования AI-приложений. Каждый инструмент закрывает свою нишу: SDK — для кастомной логики, MCP — для интеграций, Dify — для быстрого прототипирования и командной работы.

Главная проблема, с которой я столкнулся — сохранение контекста. Когда мультиагентная система используется командой, критически важно, чтобы каждый участник имел доступ к контексту запросов коллег и мог его вызвать. RAG-пайплайны с Weaviate частично решают эту задачу: документы, переписки, результаты предыдущих запросов индексируются и доступны всем агентам. Но полноценное решение требует продуманной архитектуры памяти — краткосрочной, долгосрочной и эпизодической.

Куда движется технология? Невозможно даже предугадать масштаб изменений. Возможно, мы на пороге появления мультиагентных систем с полной автономностью, которые будут проходить весь цикл разработки самостоятельно — от анализа требований до деплоя — и лишь запрашивать итоговое разрешение у разработчика на запуск готового продукта. Уже сейчас агенты пишут код, тестируют его и деплоят. Вопрос лишь в том, когда уровень доверия позволит убрать человека из цикла.

My main experience with multi-agent systems comes from deploying Dify Platform on self-hosted infrastructure. 11 Docker containers: Flask API server, Next.js frontend, PostgreSQL, Redis, Weaviate for vector search, a sandbox for safe code execution, Celery workers for background tasks. The visual workflow builder lets you chain LLM calls, RAG queries, and custom tools without writing code.

The toolkit includes Claude Agent SDK for programmatic orchestration, MCP servers for connecting external data sources, and Dify itself as a platform for visual AI application design. Each tool fills its niche: SDK for custom logic, MCP for integrations, Dify for rapid prototyping and team collaboration.

The main challenge I faced — context preservation. When a multi-agent system is used by a team, it's critical that each member has access to colleagues' query context and can retrieve it. RAG pipelines with Weaviate partially solve this: documents, conversations, and previous query results are indexed and available to all agents. But a complete solution requires thoughtful memory architecture — short-term, long-term, and episodic.

Where is the technology heading? It's impossible to predict the scale of changes. Perhaps we're on the verge of fully autonomous multi-agent systems that handle the entire development cycle independently — from requirements analysis to deployment — only requesting final approval from the developer to launch the finished product. Agents already write code, test it, and deploy. The only question is when the level of trust will allow removing humans from the loop.